Samsung “dá bronca” em empregados por colocarem dados confidenciais no ChatGPT

]]>

A Samsung pediu aos funcionários que tomem cuidado ao utilizar a popular inteligência artificial para auxiliar no trabalho, seja com revisão de códigos ou resumindo uma reunião. Estes dois casos levaram a três “compartilhamentos” de dados confidenciais da empresa. Os casos aconteceram em 20 dias desde que o uso do ChatGPT foi liberado na empresa — um incidente por semana, aproximadamente.

Samsung quer que funcionários usem ChatGPT responsavelmente

Não que é a Samsung não quer que os seus empregados parem de usar a IA, a empresa quer que o uso seja mais responsável — ao mesmo tempo em que o ChatGPT melhore o desempenho do trabalho. Nada de pedir que a ferramenta revise códigos ou atas de reuniões confidenciais.

A sul-coreana liberou o uso do ChatGPT na sua divisão de semicondutores e dispositivos, responsável pela fabricação de chips. Outras divisões da Samsung proíbem o acesso à IA. Todavia, o jornal que publicou o caso é coreano.

A tradução do jornal coreano não deixa claro se o ChatGPT usado é “padrão” da OpenAI, acessado pelo site, ou alguma API. De qualquer modo, os dois casos levam os prompts inseridos para uma empresa estrangeira, sem relação com a Samsung. Recentemente, um bug na IA permitiu que usuários visualizassem as conversas de outras pessoas com o ChatGPT.

Enquanto a Samsung puxa a orelha dos funcionários e promete “punições” a quem descumprir a orientação, a fabricante também inicia o desenvolvimento de sua própria IA generativa. Em um futuro próximo, os empregados da empresa poderão usar um “SamsungGPT” para compilar dados e fazer code reviews. Assim, as informações confidenciais ficarão em casa.

“Vazamento” de dados da Samsung no ChatGPT

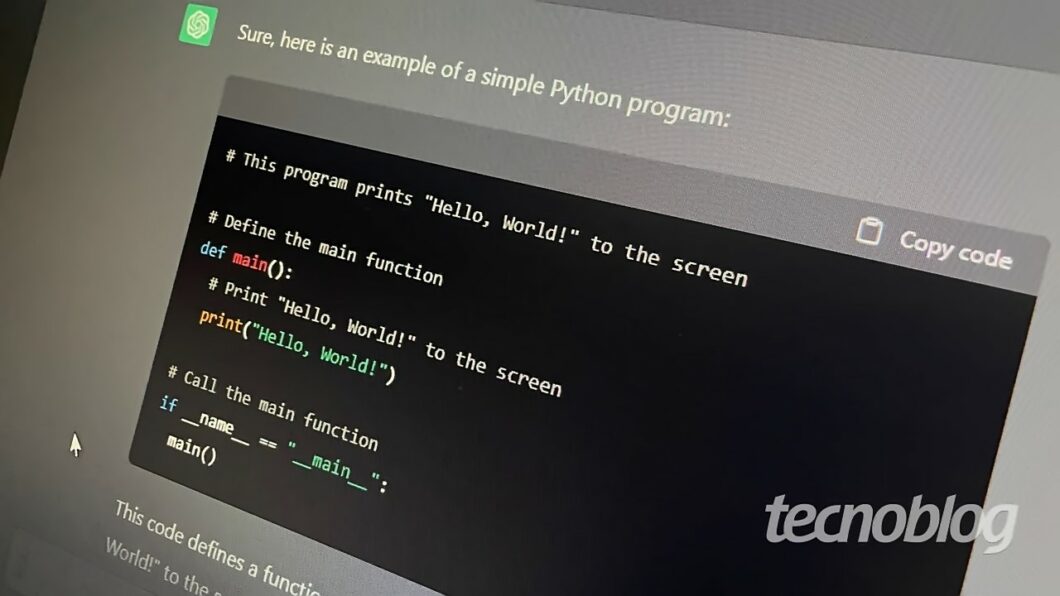

O The Economist, jornal sul-coreano sobre economia, divulgou os três “vazamentos” na segunda-feira (3). Em um dos casos, um funcionário publicou o código-fonte do programa de mensuração do banco de dados de uma fábrica no ChatGPT para encontrar erros.

O outro incidente que envolveu códigos foi mais grave, já que um empregado pediu que a IA otimizasse o programa que identifica quais fábricas estão eficientes e quais estão faltando desempenho.

No terceiro caso, a gota d’água para a Samsung, um funcionário utilizou o ChatGPT para fazer a ata de uma reunião.

Nas suas diretrizes, a OpenAI pede que os usuários não divulguem dados sigilosos ou pessoais nas suas conversas com a inteligência artificial.

Com informações: TechSpot e The Economist

Samsung “dá bronca” em empregados por colocarem dados confidenciais no ChatGPT

rastrear xiaomi pelo imei

Fonte: https://tecnoblog.net/noticias/2023/04/04/samsung-da-bronca-em-empregados-por-colocarem-dados-confidenciais-no-chatgpt/

Nenhum comentário:

Antes de deixar um comentário, acesse o site meuspy.com e veja como é fácil espionar celulares.